Als im Jahr 1905 eine Anzahl ausgewiesener Fachleute beschloss, die Blue-Mountains-Wälder im Nordosten der USA mit wissenschaftlichen Methoden nachhaltig zu bewirtschaften, geschah das unter den besten Voraussetzungen, die man sich vorstellen konnte. Die Experten hätten sich allerdings niemals träumen lassen, dass man nach hundert Jahren bestwilliger Eingriffe in dieses Ökosystem beinahe immer das Gegenteil von dem erreichen würde, was man beabsichtigt hatte: Die erwünschten Kiefern wurden nahezu überall von den nicht gewollten Tannen verdrängt; statt der im Naturkreislauf sinnvollen Kleinbrände gab es aufgrund der menschlichen Eingriffe unbeherrschbare Grossfeuer; der Schädlingsbefall potenzierte sich – und das alles bei einem stattlichen Budget von zwei Milliarden Dollar allein im Jahr 2000.

System zu komplex

«Jeder, der versucht hat, die Wälder zu reparieren, hat alles nur schlimmer gemacht», lautete das Resümee einer Untersuchung, nachzulesen im Buch «Fallstricke» von Ulrich und Johannes Frey, aus welchem dieses Beispiel entnommen ist. Wohlgemerkt, hier waren nicht zufällige Helfer oder einfach gestrickte Menschen am Werk, sondern zum Teil Ökosystemtheoretiker. Wie kann das sein, wenn doch die besten Fachleute mit ausreichenden Mitteln sorgfältig überlegte Entscheidungen getroffen haben? Die Gebrüder Frey sehen da eine Summe von Fehlern, die alle auf einen Grund zurückzuführen sind, nämlich auf die Komplexität des Ökosystems Wald. Es war den Experten nicht gelungen, so in das lebendige und hochgradig vernetzte System einzugreifen, dass es sich verbesserte. Sie haben in der Tat alles schlimmer gemacht und hätten besser die Finger davon gelassen.

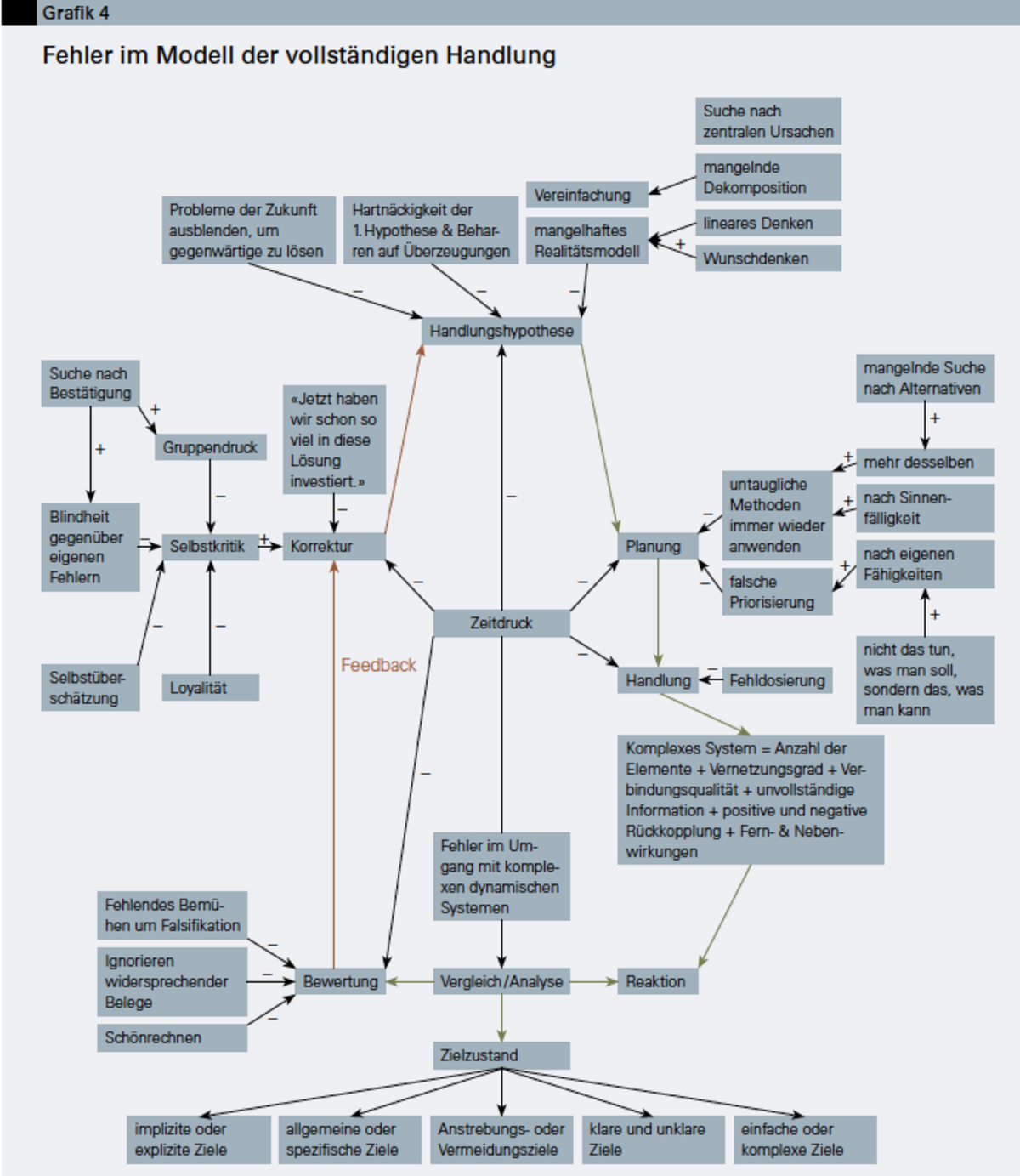

Es gibt bestimmte Fehler, die uns Menschen im Umgang mit komplexen Systemen immer wieder fast zwangsläufig unterlaufen. Im Folgenden wird versucht, einige dieser Fehler in ihrem Zusammenhang darzustellen; den Ausführungen liegen das bereits erwähnte Werk von Frey und Frey zugrunde, daneben auch das sehr lesenswerte Buch «Die Logik des Misslingens» von Dietrich Dörner, einem deutschen Professor Emeritus für theoretische Psychologie.

Eigenschaften der Komplexität

Damit wir nicht aneinander vorbeireden, ist es wichtig zu klären, was unter einem «komplexen System» verstanden werden soll. Die folgenden neun Aspekte tauchen in der Literatur immer wieder auf und sind für die Beschreibung wichtig.

1. Elemente: Im Ökosystem Wald sind das also die einzelnen Baumarten, Sträucher, Untergehölze, Pilze, Farne, Moose, Insekten, Kleintiere, Grosstiere, Wettererscheinungen und noch einiges mehr. Man erkennt bereits an dieser Aufzählung, dass schon allein die Vielzahl und die Verschiedenheit der Elemente dafür sorgen, dass man als eingreifender Mensch etwas aus dem Blick verlieren kann. Nun ist das lebendige Ökosystem Wald ein sehr komplexes Miteinander. Es gibt daneben auch einfachere Systeme, zum Beispiel in der Technik: Eine Radarfalle besteht aus einem bewegten Fahrzeug, einem Radarmessapparat und einer Kamera.

2. Vernetzungsgrad: Die Elemente können eher linear vernetzt sein, so wie die Waggons an einem Zug oder auch quer vernetzt wie die Spieler in einem Fussballmatch. Der Vernetzungsgrad bestimmt über die Anzahl und Richtung der Wirkungen, die ein Ereignis in diesem Netzwerk haben kann. Wenn die Spieler immer nur einen Anspielpartner bevorzugen und sich wenig bewegen, ist die Mannschaft geringer vernetzt, als wenn sie ständig mehrere Optionen nutzen können.

3. Verbindungsqualität: Verbindungen zwischen Elementen können fest und locker sein, also haltbar oder weniger haltbar. So sind die Verbindungen zwischen einem Schwamm und einem Baum manchmal symbiotisch und damit sehr haltbar, jene zwischen einem Specht und einem Baum oft nur temporär, nämlich zur kurzfristigen Suche nach Insekten, oder auch dauerhafter beim Bau einer Nisthöhle. Mit Qualität ist aber auch die Weitergabe von Signalen gemeint. Diese Weiterleitung kann logisch starr erfolgen, nach dem Wenn-Dann-Prinzip: Wenn irgendwo im Spinnennetz eine Fliege zappelt, dann wird das Signal in analoger Stärke weitergeleitet. Die Übermittlung kann aber auch dämpfend geschehen, wie zum Beispiel im menschlichen Gehirn: Wenn ein Signal am synaptischen Spalt ankommt, muss es einen gewissen Schwellenwert erreichen, um die Nervenzelle zu erregen. Ansonsten findet das Signal hier ein Ende. Das ist sehr sinnvoll, denn wenn das nicht geschähe, wären unsere Neuronen in einem ständigen Zustand der chaotischen Hyper-Erregung, ähnlich wie bei einem epileptischen Anfall.

4. Intransparenz: Hoch vernetzte Systeme mit zahlreichen Elementen und vielen Querverbindungen sind äusserst undurchschaubar. Wenn die Lokführer streiken, kann das auf ganz entfernte Gebiete Auswirkungen haben, beispielsweise auf den Stundenplan von Schulen mit Kindern, die den öffentlichen Nahverkehr nutzen, oder auf das Klima von Arbeitsplätzen, weil manche KollegInnen lange aufgehalten wurden und gereizt den Arbeitstag beginnen. Wenn bei lebendigen Ökosystemen wie den Wäldern der Blue Mountains an irgend einer Stelle Eingriffe vorgenommen werden, zum Beispiel bei der Auslichtung des Unterholzes, weil Kiefern mehr Licht brauchen, dann kann das überraschende Folgen haben: Entgegen der Absicht haben sich nämlich in diese Lichtungen hinein die schnellwüchsigen Tannen viel rascher verbreitet als die Kiefern.

5. Dynamik: Viele komplexe Systeme sind nicht statisch, sondern haben eine ihnen eigene Dynamik, das heisst eine Geschwindigkeit und Stärke der Weitergabe von Bewegungen oder Informationen. Ausserdem kann es nicht nur innerhalb der Struktur eine Dynamik geben, sondern die Struktur an sich kann beweglich sein. Der Ökokomplex Wald ist in einem steten Wandel von Werden und Vergehen, Fressen und Gefressenwerden begriffen. Das komplexe System Autobahnverkehr unterliegt einer Vielzahl von Einflussgrössen, die es andauernd in Bewegung halten: Vorhaben und Launen einzelner Autofahrer, wirtschaftliches Denken von Speditionen, Ferien- und Urlaubszeiten, Wettererscheinungen usw. Solch eine grundlegende Dynamik bewirkt, dass die an diesen Systemen handelnden Menschen nicht ewig nachdenken können, sondern oft zu schnellen Entscheidungen gezwungen sind. Wir kommen darauf noch zu sprechen.

6. Öffnungsgrad: Systeme können gegenüber ihrer Umwelt oder ihrem Kontext offen oder geschlossen sein. Geschlossene Systeme sind insgesamt natürlich leichter zu verstehen als offene, die durch nicht immer vorhersehbare äussere Einflüsse einer zusätzlichen Dynamik unterliegen. So kann unter Umständen ein Sonnen- und Planetensystem durch einen Kometen erheblich aus dem feinjustierten Gleichgewicht gebracht werden.