Soziale Medien wirken international. Wenn man diese für Werbung und Kommunikation mit ausländischen Kunden nutzt, muss man auch Gesetze anderer Länder beachten. Mit dem deutschen Netzwerkdurchsetzungsgesetz (NetzDG) will man die Beseitigung von kriminellen Inhalten in bedeutenden Netzwerken durchsetzen. Auch Schweizer Unternehmen müssen dafür sorgen, dass von ihren Angestellten keine solchen ins Netz gestellt werden. Auch abgesehen davon wirkt sich das NetzDG negativ auf die Kommunikation aus.

Kritik unerwünscht

Die Unternehmensberaterin Anna Keller (Name geändert) kommuniziert gern mit Kunden sowie Freunden in sozialen Medien. Anna Keller hat auch einige Kontakte in Deutschland bei Facebook. Und mit einigen von ihnen hatte sie über Politik diskutiert, mit kritischen Kommentaren über die Merkel-Regierung. Seit Juli stellte sie fest, dass ihre Kommentare immer wieder als Spam markiert wurden, und zwar auch geschäftliche, nach völlig undurchschaubaren Regeln. Einige Kontaktpersonen versicherten ihr, dass sie keineswegs ihre Beiträge als Spam deklariert hätten, sondern sie freischalten müssten. Regierungskritischen Leuten würde das immer wieder passieren. Anna Keller ist verärgert, weil sie keine Hasskommentare publiziert, sondern Wert auf Sachlichkeit legt. Besonders stört sie, dass auch Kommentare als Spam markiert wurden, die sie als Schweizerin in der Schweiz publizierte.

Ende Juni wurde das NetzDG in Deutschland beschlossen – übrigens von einer kleinen Minderheit des Parlaments – und gleich in Kraft gesetzt. Dieses sieht hohe Strafen für die Betreiber von sozialen Netzwerken vor, wenn sie sogenannte «Hasskommentare» nicht rasch genug löschen. Natürlich kann man nicht erwarten, dass alle Mitarbeitenden der sozialen Medien dieses Gesetz genauer kennen. So sind diese Phänomene zu erklären, man blockiert lieber einmal zu viel oder sperrt sogar Konten, als eine Strafe zu riskieren.

Für wen das Gesetz gilt

In den Erklärungen zum Netzwerkgesetz heisst es: Die zunehmende Verbreitung von Hasskriminalität und anderen strafbaren Inhalten vor allem in sozialen Netzwerken wie Facebook, Youtube und Twitter hat das Bundesministerium der Justiz und für Verbraucherschutz bereits im Jahr 2015 veranlasst, eine Taskforce mit den Betreibern der Netzwerke und Vertretern der Zivilgesellschaft ins Leben zu rufen. Die in der Taskforce vertretenen Unternehmen haben zugesagt, den Umgang mit Hinweisen auf Hasskriminalität und andere strafbare Inhalte auf ihren Seiten zu verbessern.

Die Selbstverpflichtungen der Unternehmen haben zu Verbesserungen geführt. Diese reichten der Regierung aber noch nicht, es würden immer noch zu wenige strafbare Inhalte gelöscht. Ein von jugendschutz.net durchgeführtes Monitoring der Löschpraxis sozialer Netzwerke vom Januar/Februar 2017 hätte ergeben, dass die Beschwerden von Nutzern gegen Hasskriminalität und andere strafbare Inhalte nach wie vor nicht unverzüglich und ausreichend bearbeitet werden.

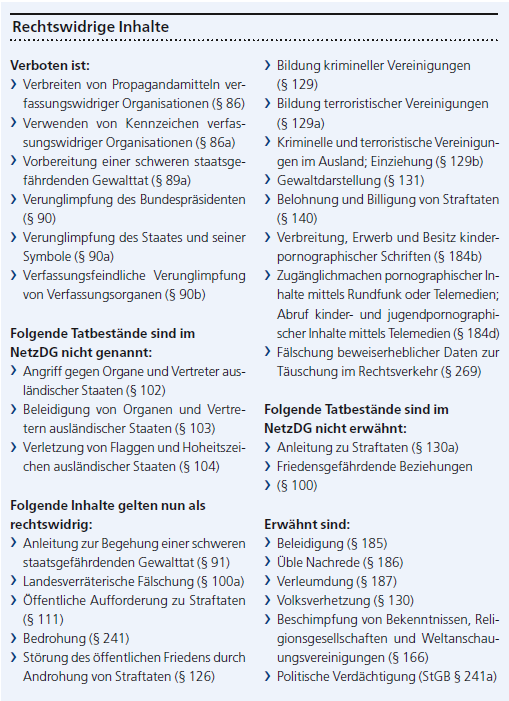

Das Gesetz gilt für Telemediendiensteanbieter, die mit Gewinnerzielungsabsicht Plattformen im Internet betreiben, die es Nutzern ermöglichen, beliebige Inhalte mit anderen Nutzern auszutauschen, zu teilen oder der Öffentlichkeit zugänglich zu machen (soziale Netzwerke). Die betroffenen Plattformen müssen mehr als zwei Millionen Nutzer haben, im Kommentar «Bagatellgrenze» genannt. Plattformen mit journalistisch-redaktionell gestalteten Angeboten, die vom Diensteanbieter selbst verantwortet werden, gelten nicht als soziale Netzwerke im Sinne des NetzDG.